DESCRIPTION :

En tant qu’administrateur global d’un tenant Microsoft 365 et Azure, je me suis retrouvé ces derniers mois face à une avalanche de questions de la part de mes collègues et de ma direction : « C’est quoi Copilot exactement ? », « Est-ce que nos données sont en sécurité ? », « Ça coûte combien ? », « Est-ce qu’on peut l’utiliser en entreprise sans risque ? ». Des questions légitimes auxquelles je n’avais pas toujours les réponses les plus précises, tant l’écosystème Copilot évolue vite.

J’ai donc décidé de me plonger dans le sujet de A à Z et de vous partager mes découvertes à travers une série d’articles sur le blog. L’objectif est simple : partir de zéro et monter en compétences progressivement sur Microsoft Copilot, que vous soyez administrateur, décideur IT, ou simplement curieux de comprendre comment l’Intelligence Artificielle s’invite dans notre quotidien professionnel.

Ce premier article pose les bases. On va voir ensemble ce qu’est un modèle de langage (LLM), ce qu’est Microsoft Copilot, comment il fonctionne, et surtout, ce qui le différencie des chatbots gratuits que tout le monde connaît. On abordera aussi la question de la confidentialité des données, parce que c’est la première chose qu’un admin ou un DSI doit maîtriser avant d’aller plus loin.

Cet article est le premier d’une série de 10 articles dédiés à Microsoft Copilot sur Infonovice.fr.

Voici le programme complet de la série :

- Article 1 (celui-ci) : Microsoft Copilot – Comprendre l’IA de Microsoft en 2026

- Article 2 : Agent IA vs Assistant IA – Comprendre les nouveaux acteurs de l’IA en entreprise

- Article 3 : Licences Microsoft Copilot en 2026 – Le guide complet pour s’y retrouver

- Article 4 : Administrer Microsoft Copilot depuis le Microsoft 365 Admin Center

- Article 5 : Sécurité et Protection des Données avec Microsoft Copilot

- Article 6 : Comprendre l’architecture des connecteurs Microsoft Copilot

- Article 7 : Déployer des connecteurs Copilot préconfigurés – Guide pratique

- Article 8 : Créer un connecteur Copilot custom et un serveur MCP

- Article 9 : Créer et administrer des agents IA avec Copilot Studio et Agent Builder

- Article 10 : Copilot Cowork, Researcher et les fonctionnalités avancées de Frontier

- Article Bonus : Checklist de gouvernance Copilot pour l’admin d’un tenant M365

Bonne lecture !

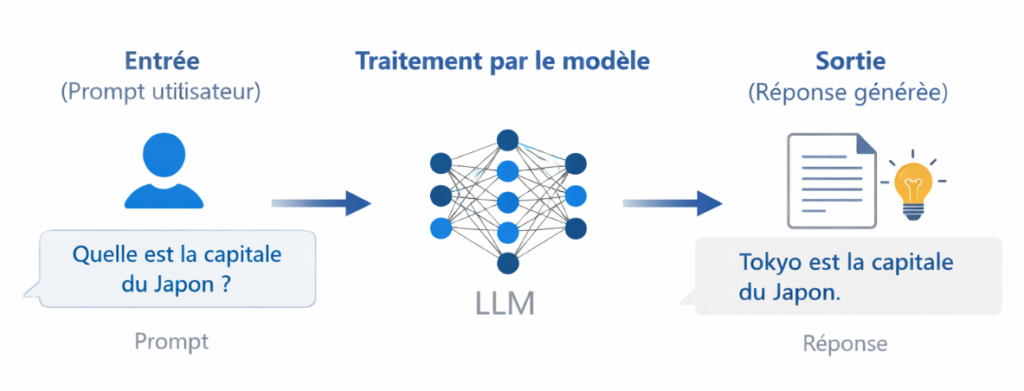

C’est quoi un LLM ?

Avant de parler de Copilot, il faut d’abord comprendre la technologie sur laquelle il repose : les LLM (Large Language Models), ou en français, les grands modèles de langage.

Pour faire simple, un LLM est un programme informatique qui a été entraîné sur des milliards et des milliards de textes issus d’Internet, de livres, d’articles scientifiques, de documentations techniques, etc. Grâce à cet entraînement massif, il est capable de comprendre du texte en langage naturel (ce que vous écrivez au quotidien) et de générer des réponses cohérentes, un peu comme un stagiaire extrêmement cultivé qui aurait lu toute la bibliothèque d’Alexandrie et qui serait capable de vous répondre sur à peu près n’importe quel sujet.

Concrètement, quand vous posez une question à un LLM, il ne « réfléchit » pas comme un humain. Il calcule statistiquement quel est le mot le plus probable qui doit suivre le précédent, et ainsi de suite, jusqu’à former une réponse complète. C’est pour cette raison qu’on parle d’intelligence artificielle : ce n’est pas de la compréhension au sens humain du terme, mais le résultat est souvent bluffant.

Les LLM les plus connus aujourd’hui sont :

- GPT-4o et GPT-5.4 d’OpenAI : ce sont les modèles utilisés par défaut dans Microsoft Copilot. GPT-5.4 est la dernière version déployée dans le cadre de la Wave 3 de Copilot en mars 2026.

- Claude d’Anthropic : depuis janvier 2026, les modèles Claude sont également intégrés dans Microsoft Copilot en tant que modèles complémentaires. Nous y reviendrons plus bas. A l’heure où j’écris cet article, Claude Opus 4.7 vient de sortir. Il cohabite également avec le modèle Sonnet 4.6 qui est plus adapté pour le quotidien et également ceux que je préfère.

- Gemini de Google : utilisé dans l’écosystème Google (Bard, Gemini). A ce jour, nous en sommes à la version 3.1 Pro.

- LLaMA de Meta : un modèle open source que des entreprises peuvent héberger elles-mêmes.

Moins connus pour le public Français, il y a également plusieurs LLMs Chinois que j’utilise.

Je listerais ceux que je préfère :

- Deep Seek et ses modèles R1 (L’un des pionnier du raisonnement), V3 et bientôt V4 à sortir en avril ou mai 2026.

- Qwen Chat V3.6 Plus

- Kimi K2

NB : Microsoft Copilot n’utilise pas qu’un seul LLM. Depuis mars 2026, il adopte une approche multi-modèle, c’est-à-dire qu’il peut utiliser plusieurs modèles d’IA simultanément selon la tâche à accomplir. C’est un changement stratégique majeur que nous allons détailler dans la suite de cet article.

Microsoft Copilot, c’est quoi exactement ?

Maintenant que vous comprenez ce qu’est un LLM, parlons de Microsoft Copilot.

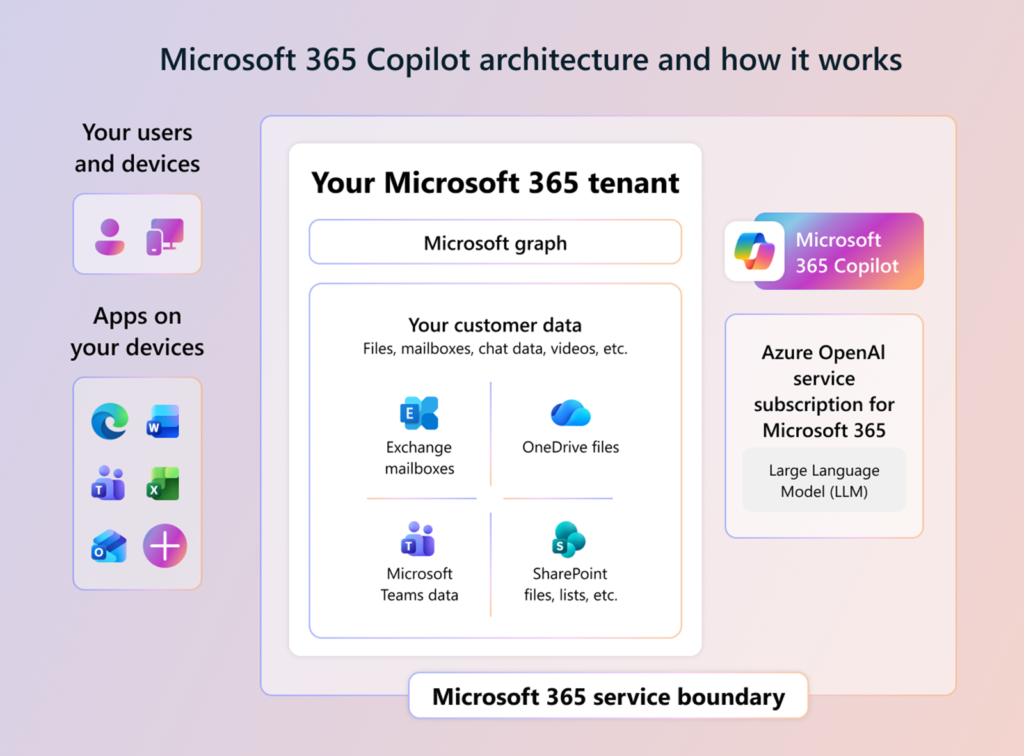

Microsoft Copilot est un assistant IA intégré à l’écosystème Microsoft 365. Il est capable de vous aider dans vos tâches quotidiennes : rédiger des emails dans Outlook, résumer des réunions dans Teams, analyser des données dans Excel, créer des présentations dans PowerPoint, ou tout simplement répondre à vos questions via un chat.

Mais attention, Copilot n’est pas un simple chatbot comme ceux que vous trouvez sur Internet. La grande différence, c’est que Copilot est ancré dans les données de votre organisation. Quand vous lui posez une question, il ne se contente pas de chercher sur le web : il est capable d’aller chercher des informations dans vos emails, vos fichiers SharePoint, vos conversations Teams, votre calendrier Outlook, etc. Tout cela grâce à un composant central qu’on appelle Microsoft Graph.

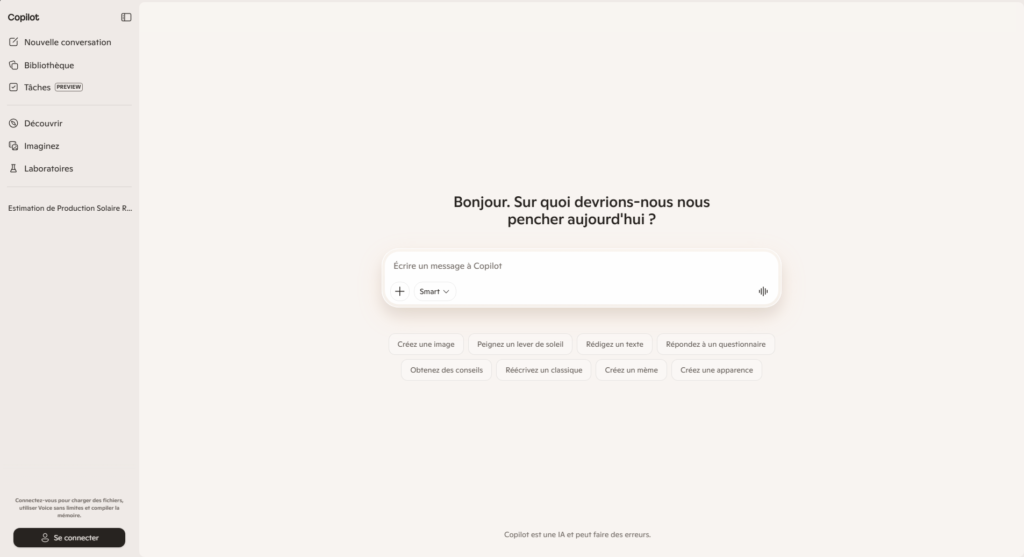

L’url d’accès à Microsoft Copilot est la suivante : https://copilot.microsoft.com/

Microsoft Graph : Le cerveau de Copilot

Microsoft Graph, c’est en quelque sorte le système nerveux de Microsoft 365. C’est une couche logicielle (une API : « Application Programming Interface » ou « Interface de Programmation d’Application » en Français) qui connecte toutes vos données Microsoft 365 entre elles : vos emails Exchange, vos fichiers OneDrive et SharePoint, vos conversations Teams, votre calendrier, vos contacts, etc.

Quand Copilot doit répondre à une question comme « Résume moi les échanges avec le client X de la semaine dernière », il interroge Microsoft Graph pour aller chercher les emails, les messages Teams et les fichiers partagés qui concernent ce client, puis il utilise le LLM pour synthétiser tout ça en une réponse claire.

C’est cette combinaison LLM + Microsoft Graph qui rend Copilot réellement utile en entreprise, contrairement à un ChatGPT classique qui n’a aucune connaissance de votre contexte professionnel.

Le concept de « Work IQ »

Depuis la Wave 3 de Microsoft 365 Copilot (annoncée en mars 2026), Microsoft a introduit un nouveau concept appelé Work IQ. C’est la couche d’intelligence contextuelle qui permet à Copilot de comprendre non seulement vos données, mais aussi comment vous travaillez, avec qui vous travaillez, et sur quels sujets vous collaborez.

En d’autres termes, Work IQ amplifie votre propre intelligence en s’appuyant sur l’intelligence collective de votre organisation. C’est ce qui permet à Copilot de vous donner des réponses pertinentes et contextualisées, plutôt que des réponses génériques.

NB : Work IQ est un concept marketing introduit par Microsoft, mais il repose concrètement sur les signaux collectés par Microsoft Graph (interactions, collaborations, fichiers consultés, etc.).

Copilot vs Copilot Chat : Quelle différence ?

C’est l’une des confusions les plus fréquentes, et je vous avoue que moi-même j’ai mis un peu de temps à m’y retrouver. Microsoft utilise le nom « Copilot » pour désigner plusieurs choses différentes. Faisons le tri.

Copilot Chat (Web) – Gratuit

C’est la version la plus basique de Copilot. Elle est accessible gratuitement via copilot.microsoft.com ou via l’application Microsoft 365 pour tout utilisateur disposant d’un compte Microsoft Entra ID (anciennement Azure AD) avec un abonnement Microsoft 365 éligible.

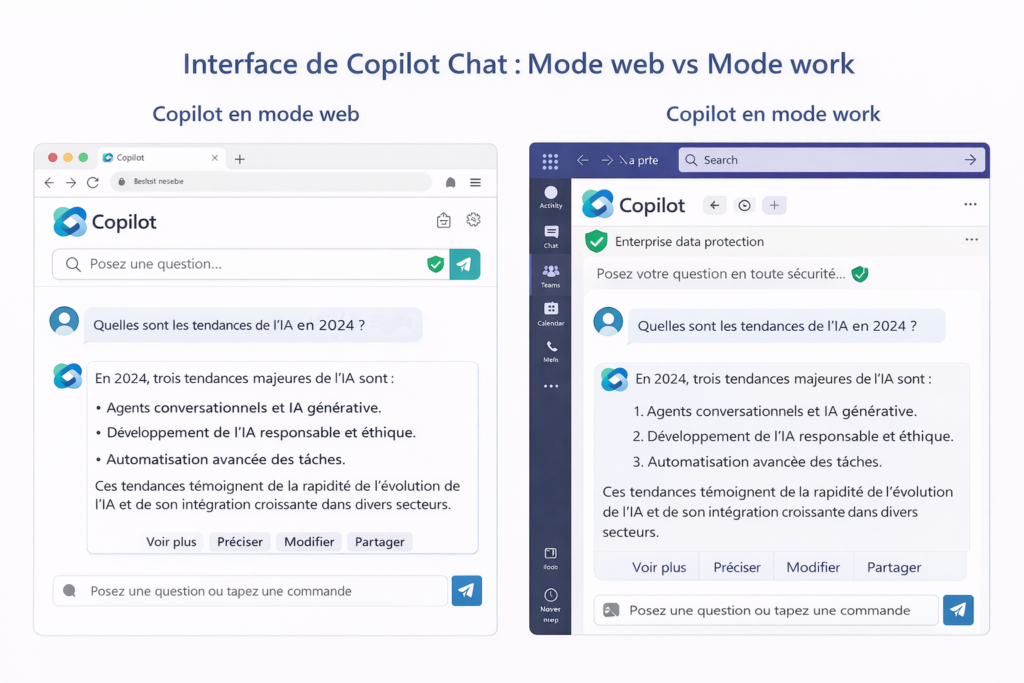

Ce Copilot Chat en mode « web » :

- Peut répondre à des questions en s’appuyant sur des données Internet (via le moteur de recherche Bing).

- Bénéficie de l’Enterprise Data Protection (EDP) : vos prompts et réponses sont protégés par le contrat DPA de Microsoft (on en reparle plus bas).

- Ne peut PAS accéder à vos données Microsoft 365 (emails, fichiers SharePoint, conversations Teams, etc.).

- Est inclus sans surcoût dans votre abonnement Microsoft 365.

Copilot Chat (Work) – Nécessite une licence Copilot

Quand vous disposez d’une licence Microsoft 365 Copilot (payante), le Copilot Chat gagne une capacité supplémentaire : il peut désormais accéder à vos données organisationnelles via Microsoft Graph.

Ce Copilot Chat en mode « Work / Travail » :

- Peut rechercher et synthétiser des informations dans vos emails, fichiers, conversations Teams, calendrier, etc.

- Respecte vos permissions Microsoft 365 : il ne montre que les données auxquelles l’utilisateur a déjà accès.

- Nécessite une licence Microsoft 365 Copilot (30$/utilisateur/mois) en plus de votre abonnement de base.

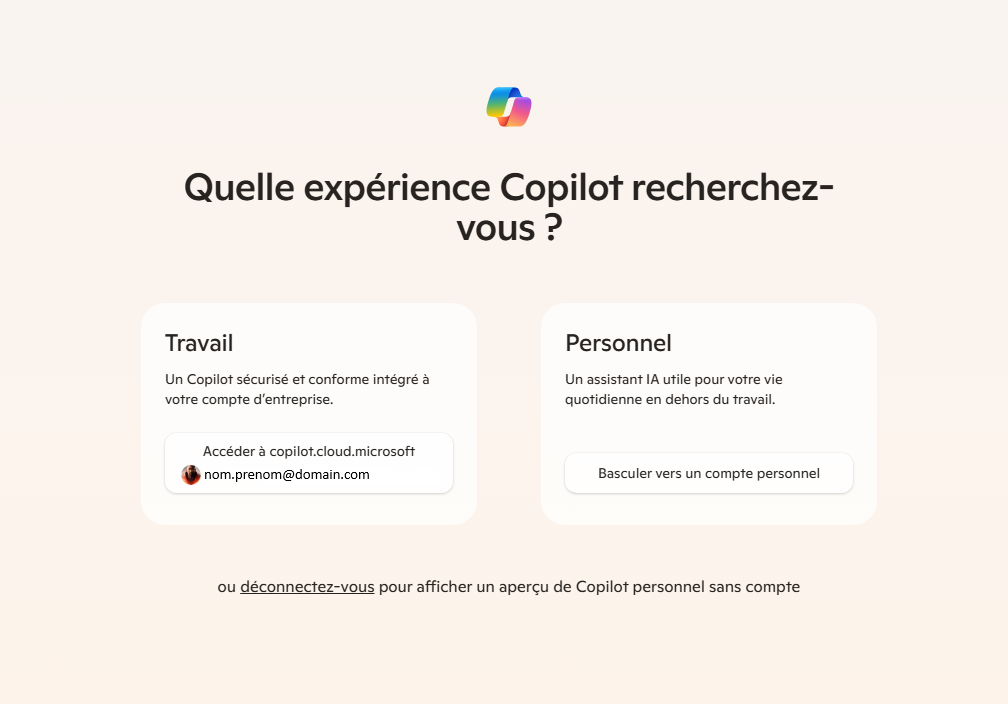

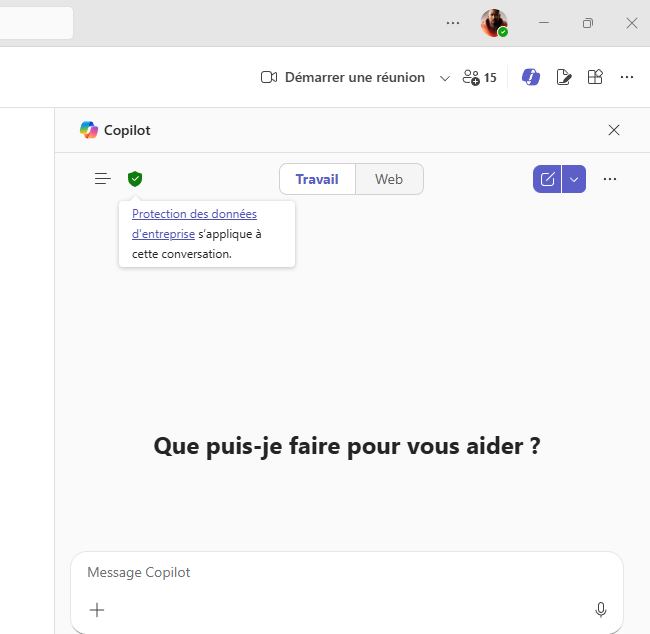

Arrivée sur le portail Microsoft Copilot, l’utilisateur peut démarrer l’utilisation du chatbot en version grand public (Copilot Chat Web) ou en s’identifiant avec ses informations de l’entreprise pour basculer en mode professionnel (Copilot Chat Work)

La version grand public est regroupé dans un espace nommé « Personnel » et la version professionnelle se situe dans un espace nommé « Travail » qui permet de s’identifier avec ses identifiants de l’entreprise :

Microsoft 365 Copilot – Intégré dans les applications

C’est l’expérience complète. Avec la licence Microsoft 365 Copilot, vous avez accès à Copilot directement dans les applications Microsoft 365 :

- Copilot dans Word : rédiger, reformuler, résumer des documents.

- Copilot dans Excel : analyser des données, créer des formules, générer des graphiques.

- Copilot dans PowerPoint : créer des présentations à partir d’un brief ou d’un document Word.

- Copilot dans Outlook : rédiger des emails, résumer des fils de discussion.

- Copilot dans Teams : résumer des réunions, générer des comptes-rendus, suggérer des actions.

NB : Dans l’interface Copilot Chat, vous pouvez identifier le mode actif grâce à un bouclier vert qui apparaît en haut de la fenêtre. Ce bouclier indique que le mode « Enterprise Data Protection » est active et vous garanti la protection des données de l’entreprise.

Le multi-modèle : GPT + Claude dans Copilot

C’est l’une des grandes nouveautés de 2026 et c’est un virage stratégique important de la part de Microsoft.

Jusqu’à récemment, Microsoft Copilot reposait exclusivement sur les modèles GPT d’OpenAI (hébergés via Azure OpenAI). Depuis janvier 2026, Microsoft a intégré les modèles Claude d’Anthropic dans certaines expériences Copilot, et depuis mars 2026 avec la Wave 3, cette intégration s’est élargie.

NB : Actuellement, l’activation des modèles d’Anthropic se font pour tout le Tenant O365. Cependant, à partir de fin avril 2026, il sera possible de limiter l’activation des ces modèles à un des utilisateurs ou groupes d’utilisateurs spécifiques.

Pourquoi plusieurs modèles ?

L’idée est simple : chaque modèle d’IA a ses forces et ses faiblesses. GPT-5.4 est excellent pour certaines tâches, Claude excelle dans d’autres (précision, analyse critique, respect des consignes). En combinant plusieurs modèles, Microsoft peut offrir de meilleures réponses selon le contexte.

Un exemple concret est l’agent Researcher (Chercheur) de Copilot. Dans son mode Critique, un premier modèle (par exemple GPT) génère une réponse initiale, puis un second modèle (Claude) joue le rôle de relecteur critique pour vérifier la précision et la complétude de la réponse. Le résultat est mesurable : Microsoft annonce une amélioration de 13,8% sur le benchmark DRACO (Deep Research Accuracy, Completeness and Objectivity) par rapport aux approches à modèle unique.

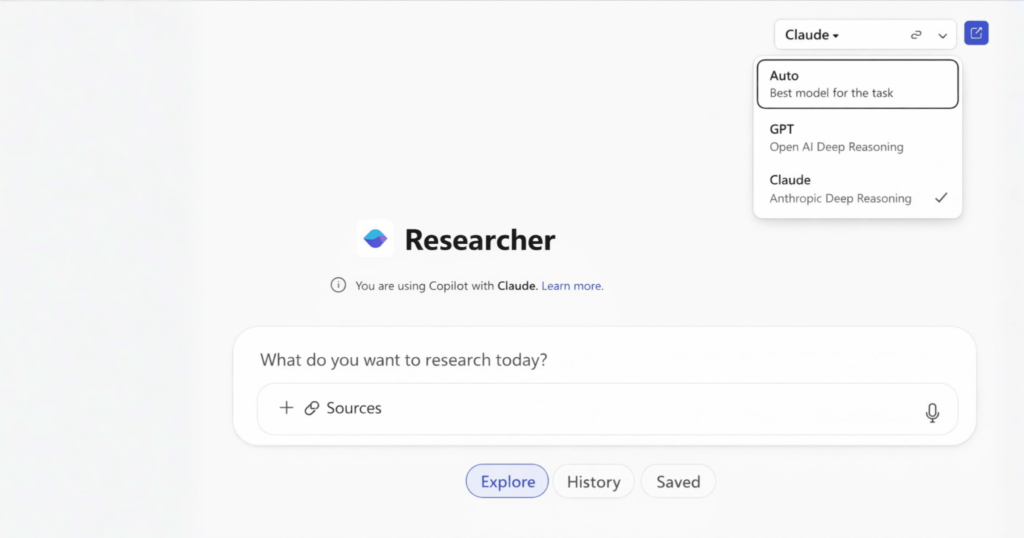

Où voit-on les différents modèles ?

Dans l’interface Copilot Chat, si les modèles Anthropic sont activés sur votre tenant, vous verrez un sélecteur de modèle qui vous permet de choisir entre GPT et Claude Sonnet. Si vous ne voyez pas ce sélecteur, cela signifie que les modèles Anthropic ne sont pas activés pour votre organisation.

NB : L’activation des modèles Anthropic est contrôlée par l’administrateur du tenant. Elle a des implications importantes en termes de résidence des données que nous allons voir dans la section suivante. C’est un paramètre que chaque administrateur doit évaluer en connaissance de cause.

La confidentialité des données : Ce que vous devez savoir en tant qu’admin

C’est LE sujet qui revient systématiquement dans toutes les discussions avec les DSI, les RSSI et les équipes juridiques. Et à juste titre. Avant de déployer Copilot dans votre organisation, vous devez comprendre comment Microsoft protège vos données.

L’Enterprise Data Protection (EDP)

Quand vous utilisez Microsoft 365 Copilot ou Copilot Chat avec un compte professionnel (Entra ID), vos interactions sont couvertes par ce que Microsoft appelle l’Enterprise Data Protection (EDP).

Concrètement, cela signifie :

- Vos prompts et réponses sont traités comme des données d’entreprise, au même titre que vos emails dans Exchange ou vos fichiers dans SharePoint.

- Vos données ne sont PAS utilisées pour entraîner les modèles d’IA. C’est un point crucial et une différence fondamentale avec les outils IA gratuits grand public.

- Microsoft agit en tant que processeur de données (data processor au sens du RGPD), pas en tant que contrôleur. C’est vous, l’entreprise, qui restez le contrôleur de vos données.

- Les interactions Copilot sont soumises aux mêmes politiques de rétention, d’audit et de conformité que vos autres données Microsoft 365.

Le DPA (Data Protection Addendum)

L’utilisation de Microsoft 365 Copilot est encadrée par deux documents contractuels majeurs :

- Le Microsoft Product Terms : les conditions d’utilisation des produits Microsoft.

- Le Microsoft Products and Services Data Protection Addendum (DPA) : l’avenant de protection des données qui définit précisément les engagements de Microsoft en matière de traitement, de sécurité et de confidentialité de vos données.

Le DPA est le document juridique qui lie contractuellement Microsoft à respecter les règles de protection des données, notamment le RGPD (Règlement Général sur la Protection des Données) pour les entreprises européennes.

NB : Le DPA est téléchargeable gratuitement sur le site Microsoft Licensing. La dernière version date de septembre 2025 au moment où j’écris ces lignes. Lien : https://aka.ms/licensingdocs

L’EU Data Boundary (Frontière de données de l’UE)

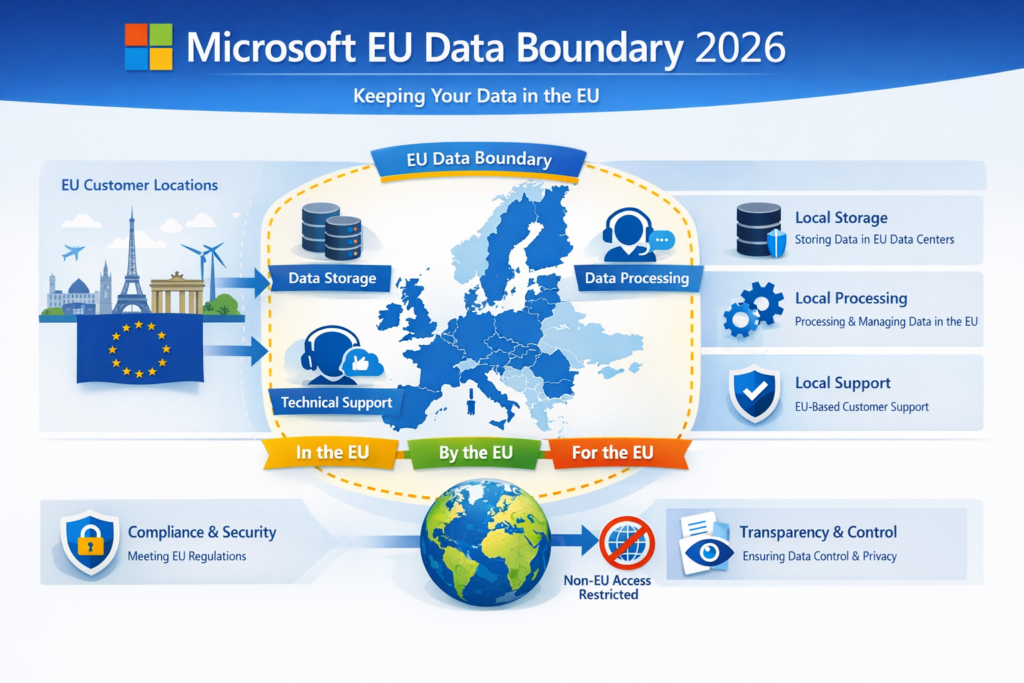

Pour les entreprises situées dans l’Union Européenne (UE) et l’Association Européenne de Libre-Échange (AELE/EFTA), Microsoft propose ce qu’on appelle l’EU Data Boundary.

L’EU Data Boundary est un engagement de Microsoft garantissant que les données clients des organisations européennes sont stockées et traitées au sein de l’Union Européenne. Cela inclut les prompts et réponses Copilot, qui sont traités sur des serveurs situés dans les datacenters Microsoft en Europe.

C’est un argument de poids pour les entreprises soumises au RGPD, à la directive NIS2 (sécurité des réseaux et de l’information), ou au règlement DORA (résilience opérationnelle numérique pour le secteur financier).

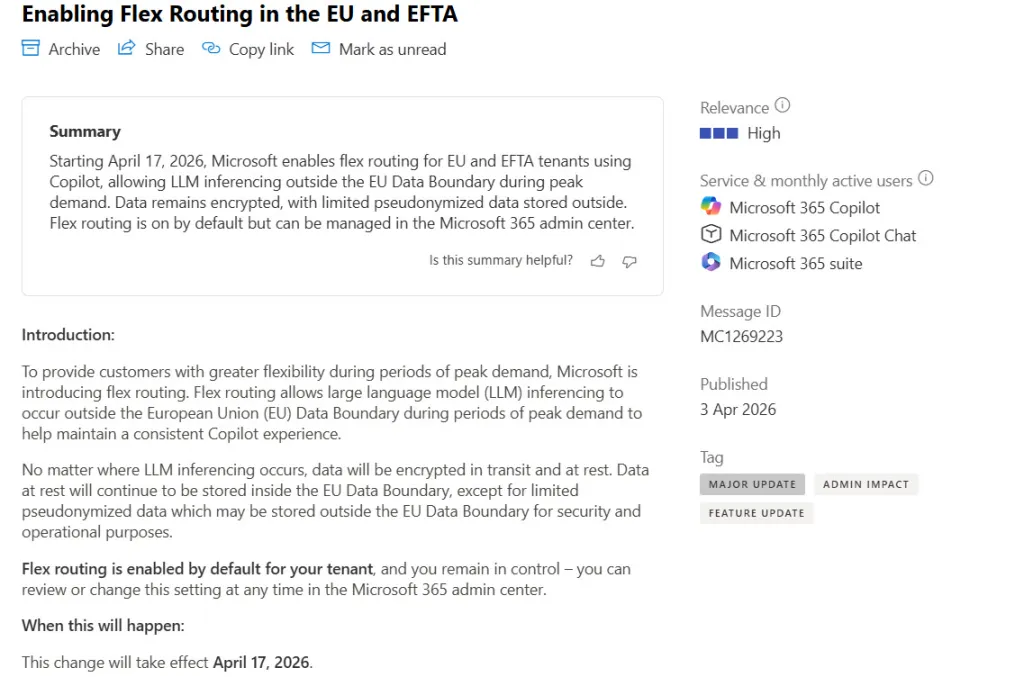

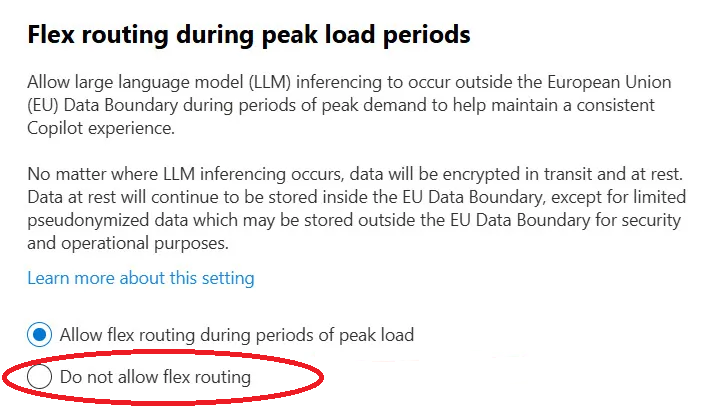

⚠️ ALERTE : Le Flex Routing – Changement majeur du 17 avril 2026

C’est un sujet brûlant d’actualité au moment où j’écris cet article, et je tenais à vous en informer dès maintenant.

Microsoft a annoncé via le Message Center (notification MC1269223) l’introduction d’une nouvelle fonctionnalité appelée Flex Routing (routage flexible). À compter du 17 avril 2026, cette fonctionnalité est activée par défaut pour tous les tenants situés dans l’UE et l’AELE.

Qu’est-ce que le Flex Routing ?

En période de forte demande (pics d’utilisation), le Flex Routing permet à Microsoft de router temporairement le traitement des requêtes Copilot (l’inférence LLM) en dehors de l’EU Data Boundary, vers des serveurs situés aux États-Unis, au Canada ou en Australie, afin de maintenir des performances stables.

Ce que cela signifie concrètement :

- Pendant ces pics, vos prompts Copilot peuvent être traités (pas stockés) sur des serveurs hors UE.

- Les données restent chiffrées en transit et au repos.

- Les données au repos continuent d’être stockées dans l’EU Data Boundary.

- Des données pseudonymisées limitées (identifiants de session, horodatages) peuvent être stockées hors UE pour des raisons opérationnelles.

Ce que vous devez faire en tant qu’admin :

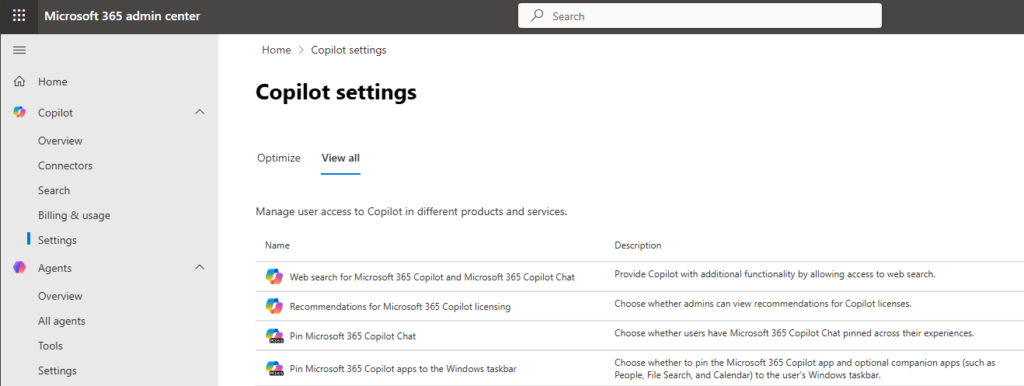

Si votre organisation exige que le traitement des données reste strictement dans l’UE (secteur bancaire, santé, secteur public, etc.), vous devez désactiver le Flex Routing dans le Microsoft 365 Admin Center :

- Connectez-vous à admin.microsoft.com avec un compte ayant le rôle AI Administrator.

- Allez dans Copilot → Settings → Flexible inferencing during peak load periods.

- Sélectionnez « Do not allow flex routing » (Ne pas autoriser le routage flexible).

NB : Les modifications de ce paramètre prennent effet dans un délai d’environ une semaine. Si vous devez agir, ne tardez pas.

NB : Ce paramètre couvre Microsoft 365 Copilot et Copilot Chat. Il existe un paramètre séparé dans le Power Platform Admin Center pour Copilot dans Dynamics 365, Power Platform et Copilot Studio, mais celui-ci respecte le paramètre du M365 Admin Center sauf s’il est configuré de manière plus restrictive.

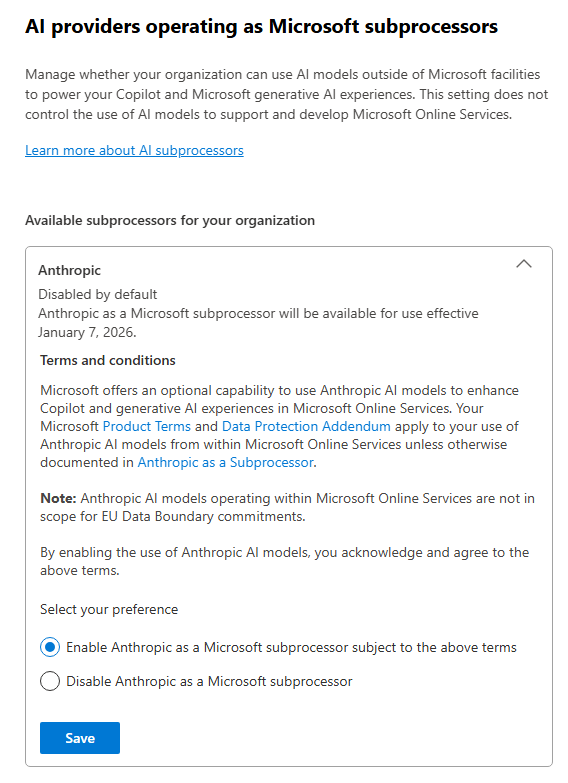

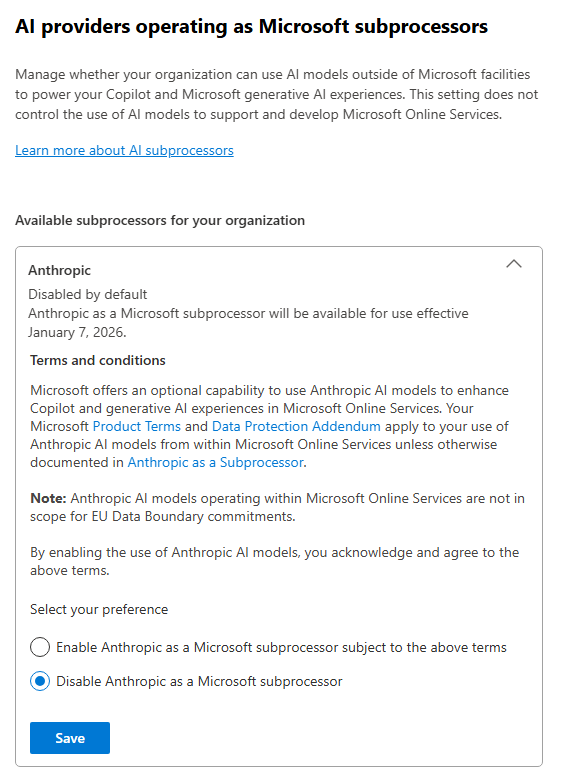

⚠️ Le cas Anthropic : Un statut particulier pour les données

Autre point crucial à comprendre : les modèles Claude d’Anthropic intégrés dans Microsoft Copilot ont un statut différent des modèles GPT d’OpenAI en ce qui concerne la résidence des données.

Les faits :

- Depuis le 7 janvier 2026, Anthropic est un sous-traitant (subprocessor) de Microsoft pour les services Copilot.

- Les modèles Anthropic sont couverts par le DPA de Microsoft et les Microsoft Product Terms. Anthropic agit sous les instructions et contrôles contractuels de Microsoft.

- MAIS : les modèles Anthropic sont exclus de l’EU Data Boundary. Cela signifie que lorsque Copilot utilise un modèle Claude, le traitement des requêtes s’effectue sur les serveurs d’Anthropic aux États-Unis.

- De même, quand les engagements de traitement « in-country » seront disponibles (prévus courant 2026), les modèles Anthropic en seront également exclus.

Ce que cela signifie pour un admin en Europe :

- Pour les tenants UE, AELE et UK créés avant le 25 mars 2026 : les modèles Anthropic sont désactivés par défaut dans les applications M365 (Word, Excel, PowerPoint). L’admin peut choisir de les activer.

- Pour les tenants créés après le 25 mars 2026 : les modèles Anthropic sont activés par défaut. L’admin peut les désactiver.

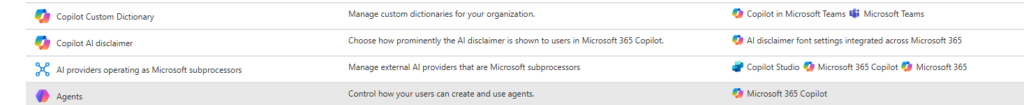

- Le paramètre se trouve dans : Admin Center → Copilot → Settings → View All → AI providers operating as Microsoft subprocessors.

NB : Si vous voyez un sélecteur de modèle dans Copilot Chat proposant « Claude » ou « Anthropic » comme option, cela signifie que les modèles Anthropic sont activés sur votre tenant. Si vous ne voyez pas ce sélecteur, ils ne sont pas actifs.

NB : L’activation des modèles Anthropic dans les applications M365 (Word, Excel, PowerPoint) est un paramètre distinct de leur utilisation dans d’autres fonctionnalités Copilot. Vérifiez la notification MC1269241 dans votre Message Center pour les détails spécifiques à votre tenant.

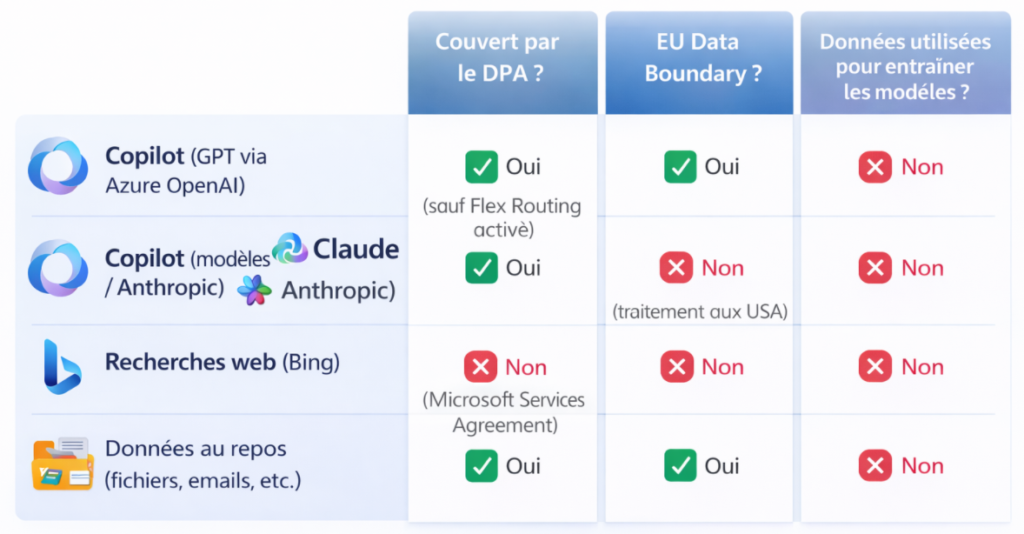

Le cas des recherches web (Bing)

Dernier point à noter : quand Copilot utilise des recherches web (via Bing) pour enrichir ses réponses, ces requêtes web ont un traitement à part :

- Les requêtes web sont anonymisées : aucun identifiant utilisateur ou tenant n’est envoyé à Bing.

- Les requêtes web ne sont pas couvertes par l’EU Data Boundary.

- Le service Bing fonctionne séparément de Microsoft 365 et est couvert par le Microsoft Services Agreement (contrat grand public), pas par le DPA d’entreprise.

- En tant qu’admin, vous pouvez désactiver les recherches web dans les paramètres Copilot si la conformité de votre organisation l’exige.

Récapitulatif : Où sont traitées vos données ?

Voici un tableau récapitulatif pour y voir plus clair :

Ce que Copilot n’est PAS

Pour éviter les malentendus, je voudrais terminer cet article en clarifiant quelques idées reçues :

Copilot n’est pas ChatGPT. Même si Copilot utilise des modèles GPT, il est fondamentalement différent de ChatGPT grand public. Copilot est ancré dans les données de votre organisation, respecte vos permissions d’accès, et est couvert par des engagements contractuels d’entreprise (DPA). ChatGPT grand public est un outil de conversation généraliste dont les conditions d’utilisation précisent qu’il est destiné au « divertissement » (entertainment purposes).

Copilot ne remplace pas un humain. C’est un assistant, pas un décideur. Il peut se tromper, générer des informations inexactes (ce qu’on appelle des « hallucinations »), ou mal interpréter une demande. Il faut toujours vérifier ses réponses, surtout pour les décisions critiques.

Copilot ne voit pas tout. Il ne peut accéder qu’aux données auxquelles l’utilisateur connecté a déjà accès. Si un fichier SharePoint est protégé par des permissions restrictives, Copilot ne pourra pas le voir pour un utilisateur non autorisé. C’est une bonne chose pour la sécurité, mais cela signifie aussi que si vos permissions sont mal configurées (trop larges), Copilot pourrait exposer des données sensibles à des utilisateurs qui ne devraient pas y avoir accès. On abordera ce point critique en détail dans l’article 5 de cette série consacré à la sécurité.

Conclusion

On a couvert beaucoup de terrain dans cet article. Résumons les points clés :

- Un LLM (Large Language Model) est la technologie d’IA sur laquelle repose Copilot. Microsoft utilise désormais plusieurs modèles (GPT-5.4, Claude) selon les tâches.

- Microsoft Copilot n’est pas un simple chatbot : c’est un assistant IA ancré dans vos données d’entreprise via Microsoft Graph et enrichi par la couche d’intelligence contextuelle Work IQ.

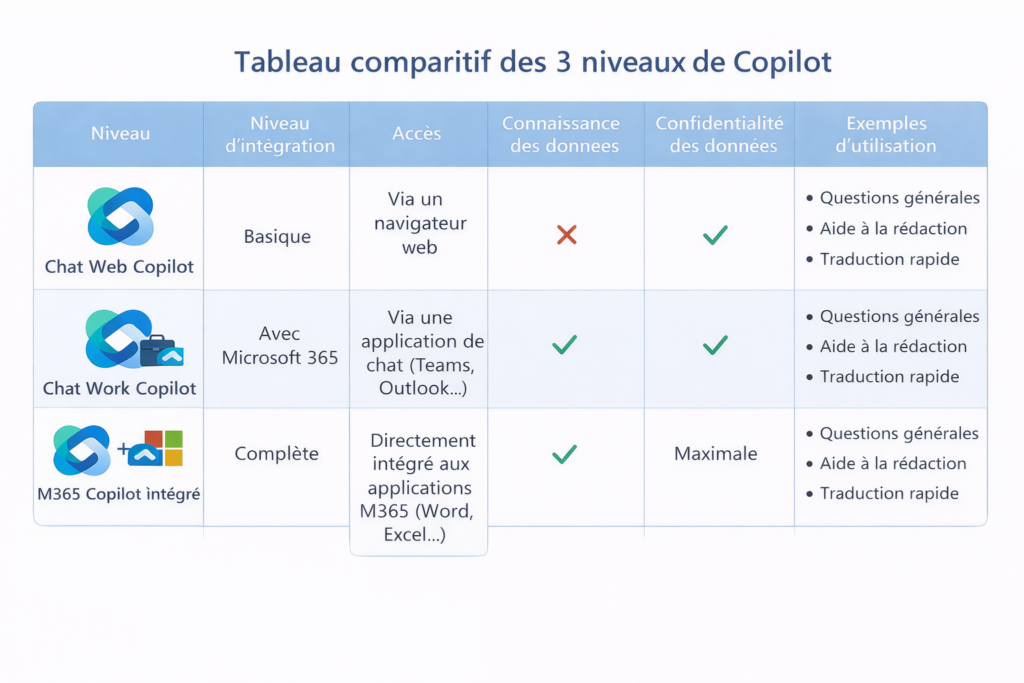

- Il existe plusieurs niveaux de Copilot : Copilot Chat gratuit (web uniquement), Copilot Chat avec licence (accès aux données M365), et Copilot intégré dans les applications (Word, Excel, etc.).

- Vos données sont protégées par l’Enterprise Data Protection, le DPA de Microsoft, et l’EU Data Boundary pour les organisations européennes.

- Attention au Flex Routing (activé par défaut au 17 avril 2026) qui peut router temporairement le traitement hors UE en cas de pic de charge. Vérifiez vos paramètres.

- Les modèles Anthropic (Claude) sont exclus de l’EU Data Boundary : le traitement se fait aux USA, sous le DPA de Microsoft avec Anthropic comme sous-traitant.

- Les recherches web Bing sont anonymisées mais ne sont pas couvertes par le DPA ni l’EU Data Boundary.

Dans le prochain article, nous verrons la différence entre un agent IA et un assistant IA, deux concepts que Microsoft utilise partout dans son écosystème Copilot et qu’il est essentiel de maîtriser pour comprendre la suite de cette série.

Un écosystème réparti sur plusieurs consoles d’administration

Avant de vous laisser, un dernier point important à garder en tête pour la suite de cette série. L’administration de Microsoft Copilot ne se fait pas depuis une seule console. En tant qu’administrateur, vous serez amené à naviguer entre plusieurs portails :

- Le Microsoft 365 Admin Center (admin.microsoft.com) qui comporte deux sections distinctes : « Copilot » (paramètres Copilot, connecteurs, facturation, settings Frontier/Anthropic/Flex Routing) et « Agents » (inventaire des agents, déploiement, outils). Ce sont deux entrées de menu séparées dans la navigation de gauche.

- Le Power Platform Admin Center (admin.powerplatform.microsoft.com) pour la gestion des environnements, des licences Copilot Studio et de la consommation des crédits.

- Le portail Entra ID (entra.microsoft.com) pour les identités des agents (App Registrations, la nouvelle section « Agent ID » en Preview), les permissions Microsoft Graph et le consentement admin.

- Copilot Studio (copilotstudio.microsoft.com) pour la création et la configuration des agents avancés.

- Le portail Microsoft Purview pour la sécurité des données (DLP, labels de sensibilité, audit, eDiscovery).

Pour ne pas avoir besoin d’être Global Admin pour toutes ces tâches, Microsoft a introduit un rôle dédié : l’AI Administrator. Ce rôle, mis à jour en mars 2026 pour supporter Agent 365, permet de gérer l’essentiel de l’écosystème Copilot et agents au quotidien sans impliquer un administrateur global. Nous détaillerons ce rôle et ses limites dans l’article 4 de cette série.

NB : Si vous voyez déjà une certaine complexité dans cette répartition multi-console, ne vous inquiétez pas : c’est normal, et c’est précisément pour ça que cette série d’articles existe. On débroussaillera tout ça progressivement.

Liens utiles :

- Documentation officielle Copilot : https://learn.microsoft.com/fr-fr/copilot/microsoft-365/

- Data Protection Addendum (DPA) : https://aka.ms/licensingdocs

- Enterprise Data Protection : https://learn.microsoft.com/en-us/copilot/microsoft-365/enterprise-data-protection

- EU Data Boundary : https://learn.microsoft.com/en-us/privacy/eudb/eu-data-boundary-learn

- Flex Routing : https://learn.microsoft.com/en-us/microsoft-365/copilot/copilot-flex-routing

- Anthropic comme sous-traitant : https://learn.microsoft.com/en-us/copilot/microsoft-365/copilot-anthropic-apps

Article rédigé en Avril 2026. L’écosystème Microsoft Copilot évolue rapidement. Les informations contenues dans cet article sont à jour au moment de la publication. N’hésitez pas à consulter la documentation Microsoft pour les dernières mises à jour.

Article suivant : [Agent IA vs Assistant IA : Comprendre les nouveaux acteurs de l’IA en entreprise]